ギター抜き音源URL

コード進行URL

歌詞URL

BPMは157です。

バッキングはアコギとエレキでお願いします。

2コーラス目のあとにギター・ソロです。

イントロとアウトロのフレーズは、打ち込みの感じでお願いします。

2月4日くらいまでにもらえると嬉しいです。

WORKSHOP

前回の「アレンジ編」では、オリジナル曲『なのはなイントネーション』のアレンジを行いました。今回の「仕上げ編」では、打ち込みのギターを生演奏に差し替え、仮歌を追加し、ミックスを行うことにします。

ぼくはほとんどの場合、ギターはnipotanというギタリストに、仮歌は小森ゆなさんという歌い手さんにお願いしています。しかし、どこかのスタジオを借りてレコーディングを行うわけではありません。二人に音源を渡して、それぞれの自宅で録音してもらっています。そしてそのファイルをネット経由で受け取り、Steinberg Cubaseにインポートしてミックスを行っています。

ギタリストのnipotanに渡すのは、全部入りの音源、打ち込みのギターを抜いた音源、コード進行を記入した譜面、歌詞の4つ。そしてメールで、おおまかなイメージとギター・ソロの位置などを伝えます。実際のメールは、大体こんな感じです。

このようにかなりあっさりとした内容で、ぼくの方から細かく指示を出すことはありません。nipotanのセンスを信頼しているので、自分では考えつかないようなフレーズをnipotanが加えてくれるのを期待しているのです。最近はずっとnipotanにお願いしているのですが、毎回“こうきたか!”と送られてきたトラックを聴いて感動しています。

今回の『なのはなイントネーション』では、以下の4つのトラックが送られてきました。

nipotan

勉強よりバンド活動に勤しむ中高生時代を過ごし、卒業後音楽家の世界に飛び込むも早々に音楽で食べることの難しさを痛感。尻尾を巻いてIT業界へと方向転換し、約10年間音楽とは無縁な日々を過ごす。そんな中、SNSでの交流をきっかけに再び音楽熱に火がつく。以来7年間、大手インターネット・サービスのエンジニアという本業の傍ら、CHEEBOW氏作編曲のライブアイドル提供楽曲中7割超のギター・サウンドを担う。「燦びやかに整ったオケに、清濁共に最も人間クサイものをインジェクションする役割」と勝手に自認している。

ポートフォリオ・サイト:http://nipotan.com/

Twitter:https://twitter.com/nipotan

仮歌の小森ゆなさんには、以下の資料を送ります。

小森ゆな

愛知県豊橋市出身。7月2日生まれのB型。幼少期から音楽を好み、小学4年生から大学卒業まで、吹奏楽/オーケストラにてトランペットを担当。交流コンサートや海外演奏旅行などにも積極的に参加する。また、声で表現することへの興味もあり、演奏会ではMCや影アナなども担当。アナウンスや声優の勉強のため、養成所付属スクールに通う。事務所への所属を経て、2009年頃よりフリーで活動。ナレーター/声優/ボーカル/作詞家など、多分野にて活動中。

ポートフォリオ・サイト:http://komoriyuna.com/

Twitter:https://twitter.com/komoriyuna72

nipontanと同じく、小森さんにもコーラスのラインなどを細かく指示することはありません。歌詞を字ハモ部分は青、Uh-Ahコーラスは赤で色分けした“ハモ指定書類”(リッチテキスト・ファイルです)を送り、実際のメロディーは小森さんに考えてもらっています。実際に歌われる方が作るコーラス・ラインは、ぼくが考えるものよりもおもしろいことが多く、ここでも化学反応を楽しんでいます。

小森さんは作業が非常に早い方で、すぐに以下のトラックが送られてきました。それぞれ、2テイク分なので、合計12トラック分のファイルです。

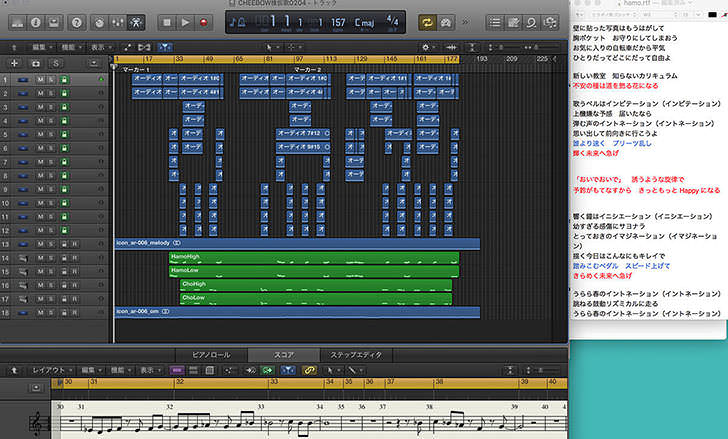

実はぼくも初めて見るのですが、今回実際に録音しているときのパソコンの画面キャプチャーを送っていただきました。小森さんは、コーラスやハモリのラインをMIDIで打ち込んでから録音されているようです。“ハモ指定書類”を、横に表示させているのも分かります。

まずはコーラスやハモリのラインをMIDIで打ち込む

そして歌をオーディオ・トラックに録音

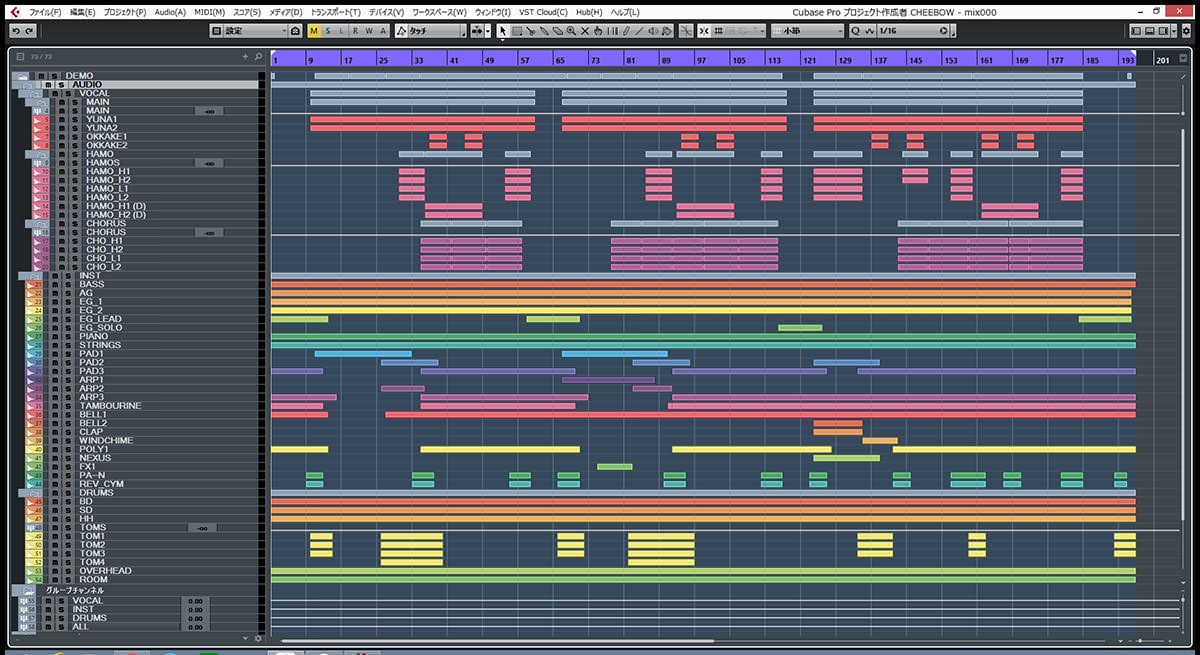

送られてきたギターと仮歌、コーラスのオーディオ・ファイルは、Cubaseのプロジェクト・ファイルに取り込みます。

ぼくがCubase上で行うオーディオの編集作業は、ノイズの除去くらいです。ボーカルの無音部分のノイズや、コーラスのブレスを除去します。ギターも同様に、耳障りなノイズを削除しておきます。

オーディオの編集作業が完了したら、打ち込みのトラックをすべてオーディオ・データとして書き出します(Cubaseのマルチ・チャンネルの書き出し機能を使い、32bit/48kHzのWAVファイルに書き出します)。打ち込みのトラックのままミックスを行う人も多いと思うのですが、ぼくはミックス前にすべてオーディオ・データとして書き出し、MIDIデータをすべて削除した“ミックス専用のプロジェクト”を作成してからミックスを行うようにしています。なぜなら、オーディオ・データのみのプロジェクトの方が立ち上がりが早いですし、のちのち使っていたソフト音源が使えなくなってしまった場合も、すべてオーディオ・データにしておけば問題ありません。もちろん、ミックスに進んでからMIDIデータを修正したくなることもあり、その場合は少々面倒ではあるのですが、一度すべてをオーディオ・データにしてしまうことで、頭を“作曲/アレンジ・モード”から“ミックス・モード”に切り替えることができるのです。どこかで区切りをつけないと、いつまで経ってもMIDIデータを修正してしまい、なかなか楽曲が完成しません。頭を切り替えるためにも、すべてのトラックをオーディオ化するというのは必要な工程だと思っています。

すべてのトラックをオーディオ化したら、無音部分のイベントを削除して、どのトラックがどこで鳴っているか分かるようにします。また、グループ・チャンネルに送ってルーティングを変えたり、トラックの色分けなども行います。

そしてフェーダーをすべて下げて、“mix000”というファイル名で保存します。この後ミックス作業に入るわけですが、途中で行き詰まったり、最初からやり直したい!と思ったときに、この初期状態のファイルがあるととても役立ちます。

いよいよミックスを行います。はじめに断っておきますが、ぼくはミックスがあまり得意ではありません。完全に独学なので、おかしな点もあるかと思います。そこはご了承ください。

ぼくの場合、ミックスに入るときにヘッドフォンをソニーのMDR-CD900STに変えます。本当は最初から最後までMDR-CD900STを使いたいのですが、このヘッドフォンを長時間使っていると耳が痛くなってしまうので、アレンジまではBose AE2を使い、ミックスのときだけMDR-CD900STを使っているのです。

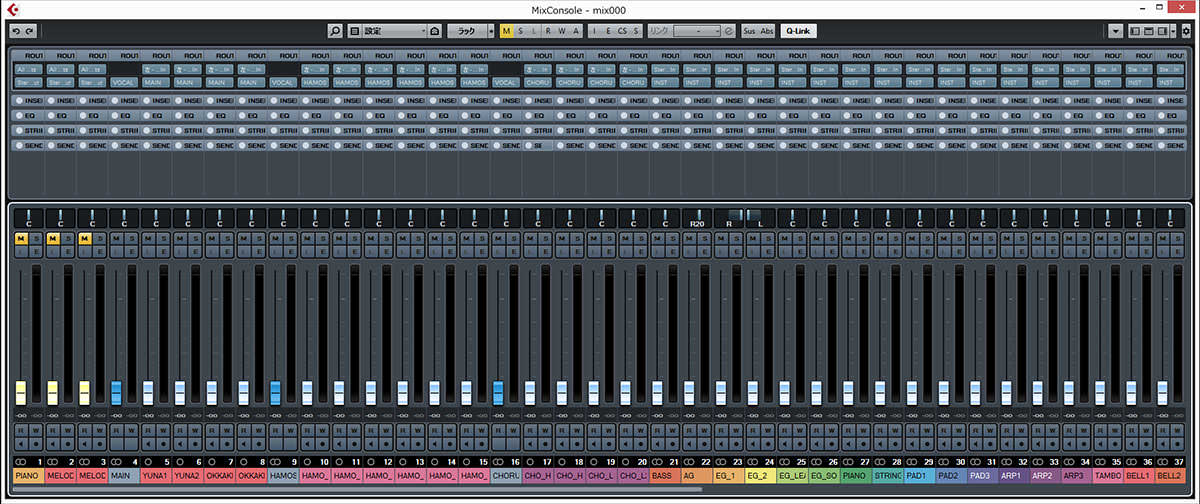

ミックスはキックから始めます。キックを-12dBくらいになるようにフェーダーを調整し、これを基準に他の楽器の音量を決めていきます。ベース、スネア、ハイハットなどのドラム・キットという順で音量を調整していき、リズムのバランスがいい感じになったら、ギターやピアノなどの上ものに手をつけます。このあたりからパンも振りつつ、ボーカルを除くすべてのトラックの音量を調整します。この段階ではエフェクトはまだ使いません。全体の音像をドライの状態で掴みます。

納得のいくバランスができたら、一度すべてのトラックをミュートし、トラックごとにミュートを外してリバーブやEQ、コンプレッサーをかけていきます。

リバーブやEQというと、どんなプラグインをどのような設定で使っているのか興味を持つ人もいると思うのですが、ここではそういうことを細かく説明しません。ぼくも昔はそういうことが気になって、雑誌や解説本を参考にしたりしました。しかしセオリーと言われるエフェクトの組み合わせや設定を自分の楽曲で試しても、何だか良くなったような気はするものの、本当に良くなったのかよく分からなかったのです。最も重要なのは、自分がイメージする音になっているかどうかです。アレンジの段階で自分が好きな音色を選んでいるわけですから、既にイメージしている音になっているのであれば、ミックスで無理に音をいじる必要はありません。もちろん、生のギターや仮歌が入ったので、それに合わせて調整する部分は出てくるでしょう。しかし、“しなければならない”ことなんてないのです。これはミックスに限らず、作曲やアレンジでもそうなのですが、凝り固まった常識を捨てて、自分でその曲にベストな方法を見つけていった方が絶対に良い結果が得られます。音楽はとても自由なものですから。

とはいえ、こういう連載記事ですので、どんな処理を行ったのか簡単に説明しておくことにしましょう。まず、キックとベース以外のトラックは、EQを使ってローをカットしました。ピアノにはちょっとキラキラした感じが欲しかったので、Nomad Factory Cosmosをかけています。また、ちょっと前に出したいトラックには、Waves Renaissance Axxも使いました。しかし必要な部分に本当に最低限のエフェクトしかかけていません。

オケのミックスの途中から、ボーカルのバランスも調整し始めます。ボーカルは、メイン、ハモ、コーラスとトラック数が多いので、上手くパンを振りつつ、広がりが感じられるように調整していきました。メイン・ボーカルの音量は、Waves Vocal Riderを使って調整しています。Vocal Riderは、オートメーションを細かく書かなくても自動で音量を調整してくれるとても便利なプラグインです。仮歌とは言っても、アイドルはそれを聴いて歌を覚えるわけですので、しっかり聴こえるようにしなければなりません。ですから昔はオートメーションを細かく書いていたのですが、今はVocal Riderのような便利なツールがあるので、いい時代になったなと思います。

ミックスができたら、最後にマスタリング的な処理も行います。具体的には、マスター・トラック最後段の1つ手前にIK Multimedia Lurssen Mastering Consoleをインサートして微調整を行います。しかしCDにするためのマスタリングではないので、がっつり音圧を上げる必要はありません。いい感じなったら、最後段にUV22HRをインサートして、16bit/44.1kHzのWAVファイルで書き出します。

書き出すファイルは、仮歌版、仮歌を抜いたライブ用カラオケ、ボーカル・トラックすべてを抜いたインスト版の3種類です。仮歌版はアイドルが聴いて歌を覚えるために、ライブ用カラオケはライブで実際に使用するトラックとして、インスト版はライブが始まる前や終わった後に会場で流すトラックとして使われます。

これで完成!のはずだったのですが、通勤途中で繰り返し聴くうちに、いくつか不満に感じる部分が出てきました。具体的には以下のような箇所が気になったのです。

ミックスに戻り、この3点を中心に修正することにしました。

アコギにはiZotope Neutronを試してみたところ、なかなか良い感じだったので、これを使うことにしました。Neutronは、トラックに合わせてコンプレッサーやEQの設定を自動で行ってくれるとても便利なプラグインです。ただ、アタックが少々強い感じがしたので、Cubase標準のEnvelopeShaperで角を落とし、さらにRenaissance Axxでちょっと音を前に出してみました。

コード・リフは、EQでおもいっきりローをカットして不要な中域もカットしつつ、高音をブーストしてみました。ここでもRenaissance Axxを使い、音を前に出してみました。

タンバリンは、ちょっとうるさく感じた帯域をEQでカットしつつ、フェーダを下げて対処しました。

EQはとても重要なエフェクトです。EQは基本的にカットする方向で使い、必要なときだけブーストするのが良いと思います。Renaissance Axxは、簡単に使えてとても便利なプラグインなのですが、いろんなトラックに使ってしまうと結局すべてが前に出てしまうので、ここぞというところで使うのが良いと思います。Neutronは、最初の音決めにはとても便利なプラグインです。ただ、ちょっと違うなというセッティングになることもあるので、自分の耳を信じて適所で使うのがいいでしょう。

これで、『なのはなイントネーション』仮歌版が完成です!

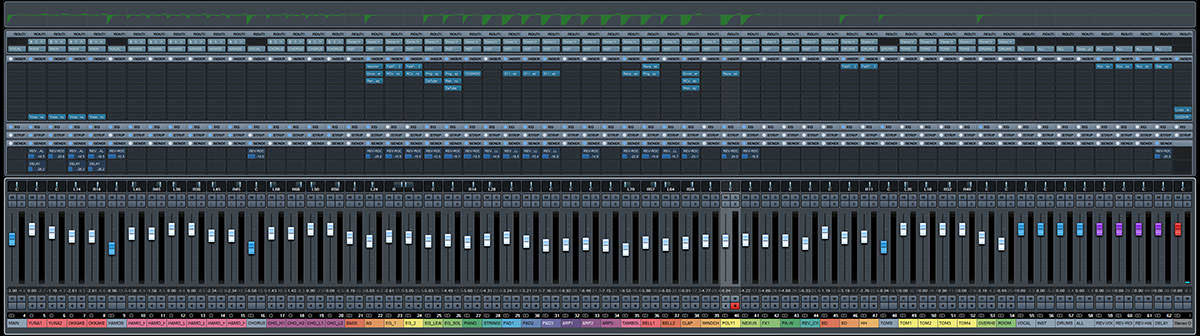

最終のミックス・バランス

本連載で制作したオリジナル曲、『なのはなイントネーション』を1組のアイドルに無償で提供します! グループやソロなど、アイドルの活動形態は問いません。末長くこの曲を愛してくれるアイドルに歌ってもらいたいと思っています。『なのはなイントネーション』を歌いたい!というアイドルの運営さんは、以下の項目をメールでお送りください(アイドル本人からの応募は受け付けていません。必ず運営さんがメールしてください)。

メールのタイトルは『「なのはなイントネーション」歌いたい!』で、アドレスは idolsong@idolsong.jp です。締め切りは、3月10日(金)。すべてのメールに目を通してしっかり選考します。ふるってご応募ください!

読者の方から質問をいただきましたので、お答えしたいと思います(質問がある方は、ぜひ idolsong@idolsong.jp までメールください!)

ひょんなことからアイドルさんに曲を提供するようになったとおっしゃっていましたが、最初の1曲目はどのように決まったのでしょうか。

ぼくがアイドルに曲を提供したのは、夢眠ねむちゃんの『魔法少女☆未満』という曲が最初なんですが、彼女が所属する秋葉原ディアステージに知り合いがいて、その人から“曲を書いてみないか”と誘われたんです。ただ、このときぼくのメインの活動は同人音楽で、その延長でたまたま自分の曲を歌ってくれるのがアイドルという感じでした。この曲がかなり好評で、その後も秋葉原ディアステージに所属する別のアイドル・グループに楽曲を提供することになり、現在のぼくの活動に繋がっていきました。なので、たまたま声をかけてもらったのがアイドルに楽曲を提供するようになったきっかけなのです。しかし、何の活動もしていなければ、声はかからなかったと思います。もしアイドルに楽曲を提供したいのであれば、アウトプットはきちんと続けていく必要があると思います。

先日ライブで聴いて、その場でCDを買ってしまいました。アイドルソングなのに変拍子。音のかっこよさと、声の甘さのギャップも良くて、何度も繰り返し聴いています。他の楽曲もとても良いので、ぜひアルバムも聴いてみてください。

『アイドルソングの作り方』第8回は、2017年3月14日(火)に掲載します。