WORKSHOP

『ホーム・マスタリング入門』by SUI 〜 自宅の一室で、Steinberg WaveLabを使って行うマスタリング

“プロデューシング・エンジニア”を名乗り、作曲/編曲/プロデュースだけでなく、ミックス/マスタリングもこなすSUIさん。最近では、eMix/eMastering(インターネット経由でのミックス/マスタリング・サービス)を本格的にスタートしたことでも注目を集めています。しかしながらそんなエンジニア的な作業も、基本自宅の一室で行っているとのことで、使用している機材もアマチュアの人たちと大して変わらないとのこと。「むしろマスタリングは自分が聴き慣れた環境でやった方がいい」と語るSUIさんに、スタジオ環境ではない自宅の一室での『ホーム・マスタリング術』について話を伺ってみました。これからマスタリングを始めてみようと思っている方はぜひ参考にしてください。

マスタリングで行うのは、『周波数分布の均等化』と『音圧調整』の2つ

マスタリングを始めたきっかけ

ぼくがマスタリングを始めたのは2000年代初頭のことで、当時周りのアーティストやDJがミックスCDを大量に作っていたんです。ミックスCDで名を上げて、レコード会社との契約を勝ち取る時代というか。そしてそういう作品は、マスタリングを経ずに世に出てしまうものがほとんどで、せっかく内容が良いのにもったいないなと思い、半ば必要に迫られてやり始めた感じですね。ミックスやレコーディングを始めたときもそうで、何か新しいことを始めるときはいつも必要に迫られているんです(笑)。

でも、それまではマスタリングだけは自分が踏み込んではならない領域だと思っていました。ミックスまでは音楽を作るクリエイティブな作業と言えますが、マスタリングは音楽を“商品”として仕上げるための最終工程で、まったくの別物だと思っていましたから。それは実際にマスタリングを手がけるようになった今でも感じていることです。

ぼくが手がける作曲やアレンジの仕事は、幸いにも予算がそれなりにある場合が多いので、マスタリングに関しては(自分で手がけずに)なるべくお願いするようにしています。やはりプロのマスタリング・エンジニアにお願いすると、いろいろ発見があったりするんですよ。海外のマスタリング・スタジオの場合は難しいですが、国内の場合はなるべく立ち会うようにしています。もちろん、結果的に“これだったら自分でやった方がよかったかな”と感じる場合もありますよ。でも人にお願いすると、そういうことも含めて勉強になるんです。

マスタリングで行うべき処理

マスタリングを手がけるようになってから、この工程では一体どのようなことを行わなければならないのか、自分なりにかなり勉強しました。これまでいろいろな仕事を手がけてきて、この工程で行うべき処理は大きく2つあると考えています。

1つは、『周波数分布の均等化』。アルバムなどで複数の楽曲の周波数分布を均すだけでなく、マスタリングでは楽曲内での周波数分布も均す必要があります。やはり良いモニター環境で聴くと、ある帯域のわだかまりとか、変に出っ張っている部分があったりする。それをきれいに均していくんです。

もう1つは、『音圧の調整』。今は皆、ミックス段でマスター・トラックにリミッターなどをインサートして音圧を稼いでいると思うんですが、アルバムなど複数の楽曲で構成される作品の場合はそれだけでは成立しません。他の楽曲とのバランスを考え、1つの作品として成り立つように音圧を調整する必要があるんです。

ぼくもミックスのときはマスター・トラックにリミッターをインサートして音圧を稼ぎますが、その曲をマスタリングに出す場合はリミッターは外します。だったら最初からリミッターなんかインサートしない方がいいんじゃないかと思われるかもしれませんが、プロの現場ではミックス段でアーティストやスタッフにOKを貰わなければならないんです。なのでミックス段でも一応、そのままCDになっても問題ないくらいの音圧に持っていく。でもそれは、あくまでもプレヴュー用の音圧処理なんです。ちなみにミックス時にマスター・トラックにインサートしたプラグインで、マスタリング前に外すのはリミッターだけです。

配信に合わせたマスタリング

現在、マスタリング時に最も重視しているフォーマットは、Apple Music/iTunesの256kbps AACです。WAVを単純に変換したのではCDとかなり印象が変わってしまうので、最初から256kbps AACを念頭にマスタリングします。具体的には、ダンス・ミュージックで重要な中低域のニュアンスが、WAVと256kbps AACではかなり違うので、その部分でなるべく差がつかないような処理を施します。

マスタリング・ソフトウェア

マスタリング・ソフトウェアは、7年くらい前からSteinberg WaveLabを愛用しています。確か最初に使ったのはバージョン5だったと思います。それ以前は別のメ−カーのものを使用していたんですが、そのソフトウェアがバージョン・アップによって凄く使いにくくなってしまったんですよね。それで躊躇していたらメーカーから、“このタイミングでバージョン・アップしないと、後は知らないよ”というメールが届いて……。個人的にそういうソフトウェアはあまり好きではないので、他の製品に移行しようと思ったんです。いろいろ選択肢があった中でWaveLabをセレクトしたのは、一番価格が安かったから。あと作曲/編曲では同じSteinbergのCubaseをメインに使っているというのもありました。Cubaseが使いやすかったので、WaveLabも同じ感じなのかなと期待していたんですが、実際は使いづらくて最初の印象は良くなかったですね(笑)。でもバージョンが上がる度にどんどん使いやすくなっていきました。

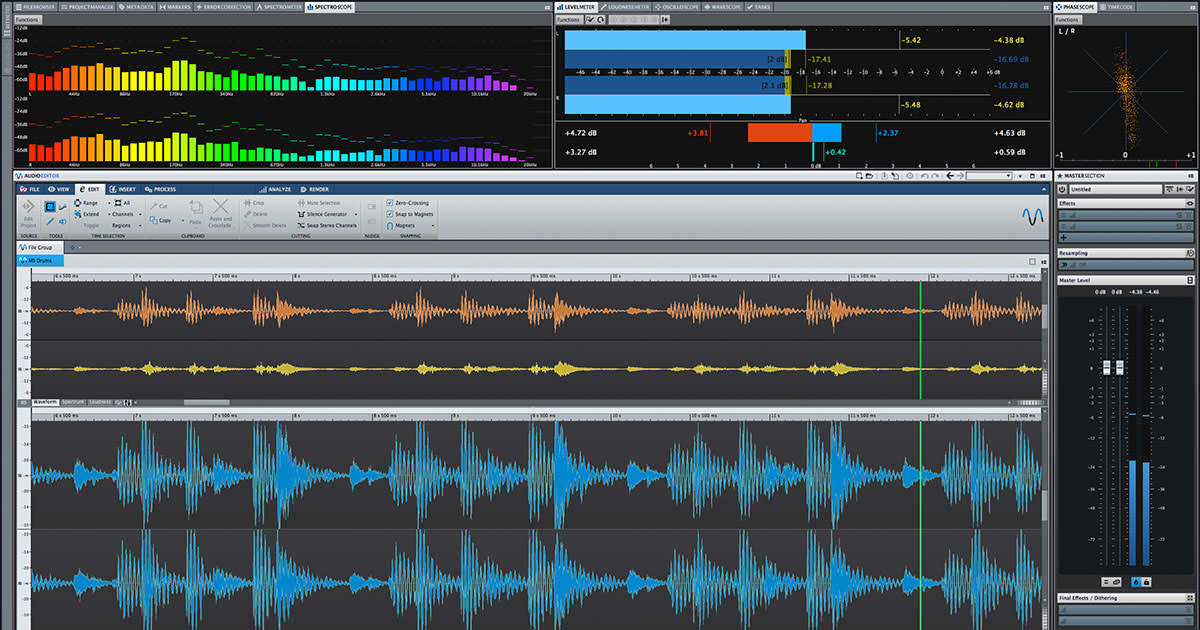

Steinbergのマスタリング・ソフトウェア、WaveLab Pro 9

現在は最新のWaveLab Pro 9を使用しています。WaveLab Pro 9ではユーザー・インターフェースのデザインが変わって、以前よりも格段に視認性が良くなりました。あとは単純にデザインがいい。デザインがいいと作業が楽しくなりますよね。

また、ホスト・ベースでのM/S処理も可能になりました。プラグインでM/S処理をすると逐一ステレオにサミングされてしまいますが、ホスト・ベースならば入り口から出口までM/Sで完遂できます。個人的にはM/Sってそんなに使わないんですが、あれでしかできない音作りというのがあるのは確かなので、機会があれば使い込んでみたいと思っている機能です。

それとMasterRigというマスタリング・プラグインが付属するようになりました。MasterRigは、iZotope OzoneやFabFilterといった定番に近い感触のプラグインで、後発なだけにかなり研究しているなという印象です。音も自然でクリアなので、これからマスタリングを始めるという人は、とりあえずWaveLabだけで十分こなせると思いますよ。

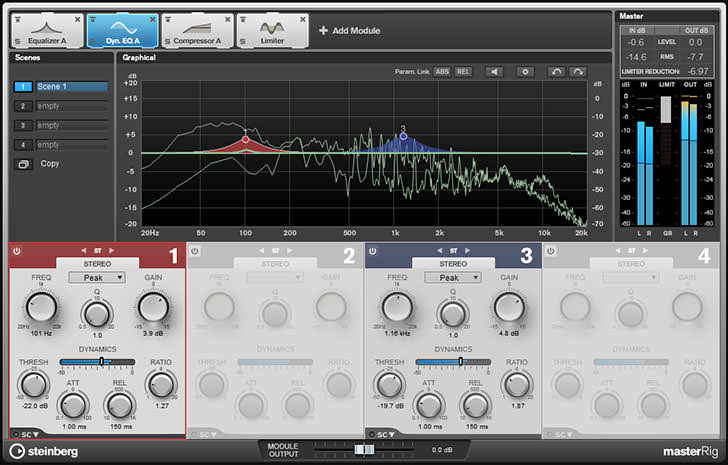

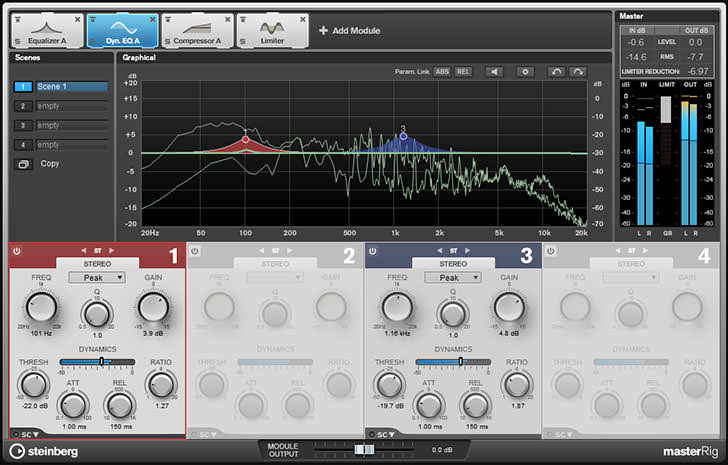

WaveLab Pro 9に標準で付属するマスタリング・プラグイン、MasterRig

マスタリング作業に入ってから、“これはミックスに戻った方がいいな”と感じることもよくあるんですが、WaveLab Pro 9ではCubaseとの連携もできるようになっています。ぼくの場合Cubaseはアレンジまでで、ミックスはPro Toolsで行うことが多いんですが、WaveLabにこんな機能が付いてしまうと、ミックスもCubaseでやりたくなってしまいますね。

マスタリング時のモニター環境

自宅のスピーカーはADAM Audio A3Xに自分で手を加えたもので、ヘッドフォンはSennheiser HD600のDelrimour Modernカスタムを使用しています。ぼくがマスタリングを手がける場所はほぼ100%自宅で、そんなに大きな音は出せないんですが、ヘッドフォンを使えば問題はありません。音作りは基本ヘッドフォンでやり、全体のコンプ感と定位に関してはヘッドフォンでは無理なので、その部分はスピーカーで確認しています。

たまに“よくそんなシステムでできるね”と言われることもありますが、むしろマスタリングは自分が聴き慣れた環境でやった方がいいと思います。マスタリングは、ミックスとは違う商品としての仕上げ作業ですから。ぼくの場合、iTunesもYouTubeもNetflixもHuluも、全部A3XとHD600で聴いているわけですよ。だからそのセットが一番耳が慣れている。自宅でマスタリングした作品を外のスタジオで大音量で聴いて、失敗したなと感じたことは一度もないですね。ぼくの場合外のスタジオで大音量でやるメリットは、作業が早くなることくらい。あとはアーティストやクライアントの立ち会いのもと、一緒に仕上げる場合などです。基本的には自分が聴き慣れたスピーカーとヘッドフォンがあれば、自宅でも十分マスタリングはできます。

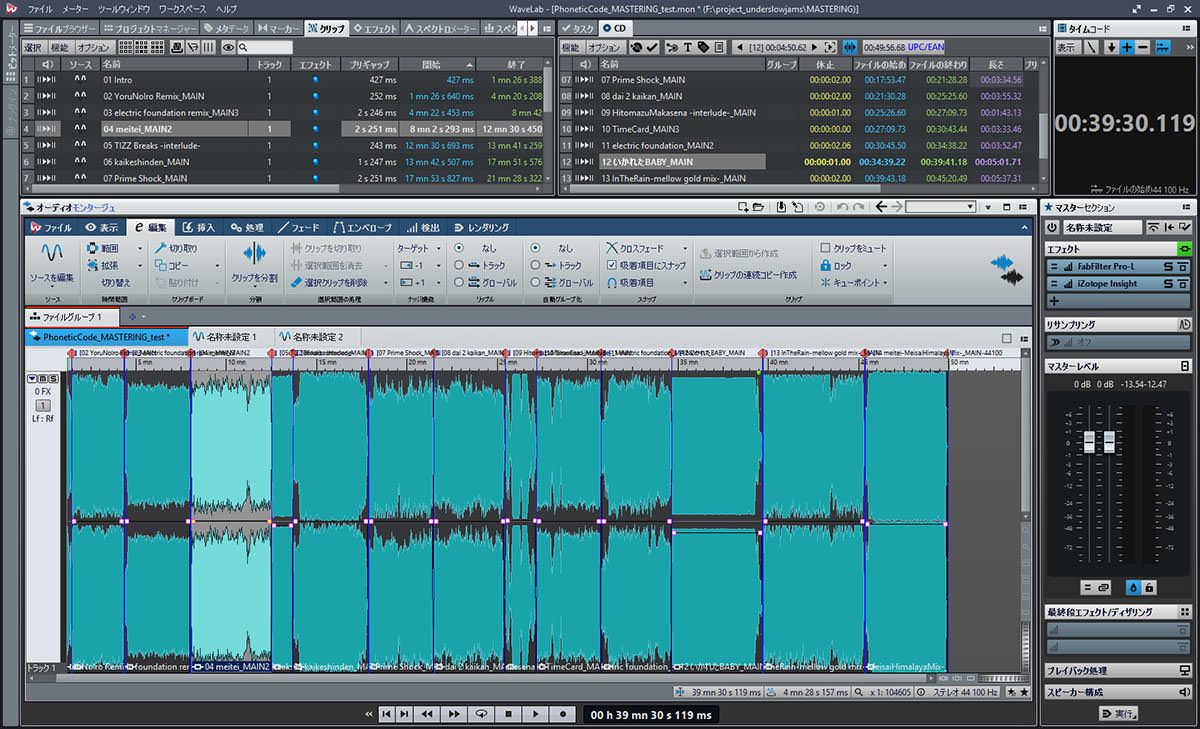

WaveLabを使用したマスタリングの流れ

それでは次に、ぼくが普段行っているマスタリングのフローを紹介することにしましょう。WaveLabを使った解説になっていますが、他のマスタリング・ソフトウェアでも“やるべきこと”は変わらないと思います。

1:音源の試聴/フォーマット変換

まずはすべての音源(楽曲のファイル)をWaveLabの『オーディオファイルワークスペース』に読み込んで、じっくり聴き込みます。例えば、10曲入りのアルバムをマスタリングする場合は、10個の音源を読み込んでWaveLabで聴く。その時点でちょっと手直しが必要と感じた場合は、自分がミックスした音源に関してはCubaseやPro Toolsに戻って修正することもありますし、人がミックスした音源に関しては一度DAして、外部のアウトボードを使って補正することもあります。

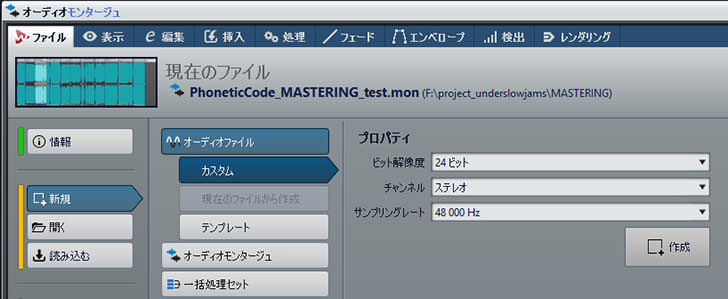

サンプリング・レートとビット・レゾリューションを変換するタイミングは作品によってまちまちなんですが、『オーディオファイルワークスペース』に読み込んだ段階で、オーディオファイルのプロパティで一括変換してしまうことが多いです。

オーディオファイルのプロパティで、サンプリング・レートとビット・レゾリューションの一括変換を行う

オムニバス・アルバムですと、楽曲によってサンプリング・レートやビット・レゾリューションがバラバラだったりするんですが、ここで一括変換してフォーマットを揃えてしまう。その際のフォーマットは、16bit/44.1kHzのときもありますが、最近は24bit/48kHzが基本になっています。なぜ24bit/48kHzかと言えば、ぼくの場合はテレビ・ドラマや映画など映像系の仕事が多いからなんですが、24bit/48kHzの方が若干深い処理ができるからです。ハイレゾ配信が予定されている楽曲の場合、24bit/96kHzで作業することもありますが、後で変換したときの落差が激しいので、そういう仕事も24bit/48kHzで作業することがほとんどですね。

2:音源のトリートメント

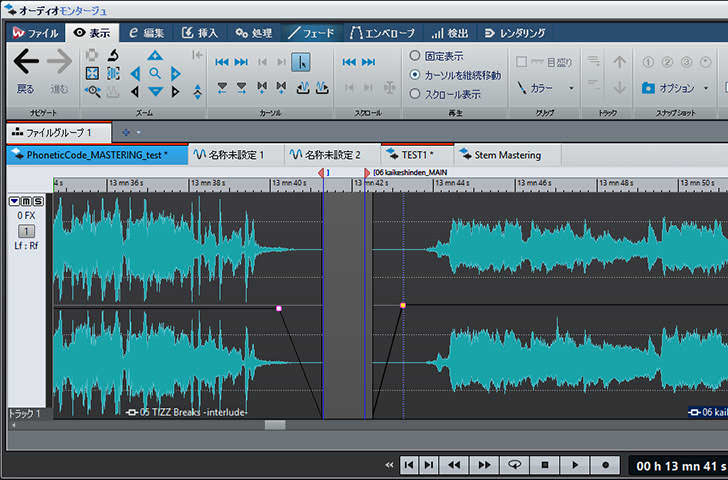

そして『オーディオモンタージュ』上で、音源単位、つまりクリップ単位で音作りを行います。音作りは基本プラグインで行うんですが、WaveLabはクリップごとにプラグインをインサートすることができるんですよ。ですので楽曲ごとにプラグインをインサートして音作りを行います。

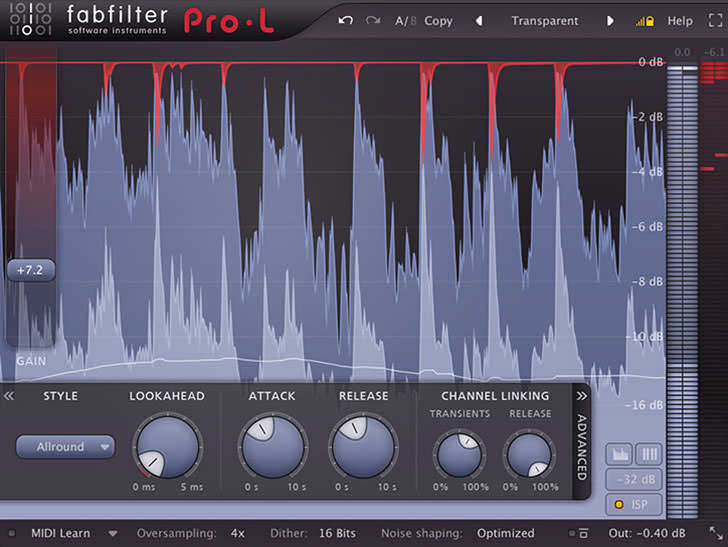

特に決まったプラグインのセットというのは無いんですが、基本となるのはダイナミックEQ、イコライザー、リミッターのチェーンですね。リミッターは最後ですが、ダイナミックEQとイコライザーの順番は楽曲によって変わります。また必要に応じて、リミッターの前段にコンプレッサーをインサートすることもあります。具体的には、ダイナミックEQとイコライザーはiZotope Ozone、リミッターはFabfilter Pro-LとA.O.M. Invisible Limiter G2を使うことが多いですね。

iZotope Ozone

Fabfilter Pro-L

A.O.M. Invisible Limiter G2

ダイナミックEQとイコライザーでは、周波数分布のバランスを整え、またCDなどのメディアになった際の音の変化を想定して微妙な補正を行います。やはり出力するメディア形態によって音が変わってしまうので、特に16kHz以上のハイエンドと50Hz以下の低域のトリートメントを行う。これはどんな楽曲に対しても行いますね。あとは150〜400Hzあたりを削り、日本人の作品は2〜3kHz付近にシビランスを含めいろいろな音の輪郭が集中しているので、その部分を調整します。結果的に高域が微妙に持ち上がって、低域が下がり気味のカーブになることが多いですね。

MasterRigのダイナミックEQ

2種類のイコライザーを併用する理由は、ダイナミックEQはレベルが入ったときだけ、つまりスレッショルドを超えたときだけ動作するので、かかりが均一ではなく音楽的なんです。一方、普通のイコライザーは入ってくるレベルに関係なく均一にかかるので、製品的な処理に長けている。どちらにも良さがあるので併用しています。

MasterRigのイコライザー

そして少し音色を調整したいと思った場合は、最後のリミッターの前段にコンプレッサーをインサートします。コンプレッサーを使って、低域の迫力を出したり、中域に厚みを加えたり、高域の輝き感を増やしたりします。圧縮することで元々ある音を強調するという使い方ですね。

MasterRigのコンプレッサー

最後のリミッターでは音圧を稼ぎます。具体的にはスレッショルドを調整して大体5dBくらいリダクションします。5dBもリダクションすると、前段のトリートメントをしっかりやっていないと大抵はどこかが歪んでしまうんですよ。大体4dBくらいから歪み始める。ですから5dB程度リダクションできるということは、前段のトリートメントが上手くいっているということなんです。

MasterRigのリミッター

以上が音源単位での処理ですが、もちろんトータルにもリミッターをインサートします。しかし音圧に関しては基本音源単位で調整できているので、トータルのリミッターでは0dBを超えないようにして、インターサンプルを叩いています。もちろん音圧が足りないと感じた場合は、最終段で持ち上げますが、音源単位のリミッターとトータル・リミッターの2段階で持ち上げた方が結果的に自然に音圧を稼ぐことができますね。

マスタリングで上手くプラグインを使うコツは、トリートメントという意識を持つことだと思います。音を変えるのではなく、少しずつ少しずつ補正していく。この段階で大胆にプラグインをかけるのなら、ミックスをやり直した方がいいと思います。

3:曲間の調整

次に行うのが曲間の調整です。曲間は実際に耳で聴きながら決めていくんですが、最近のダンス・ミュージックですと1秒を起点に始めることが多いですね。でも正直、配信の普及によって、曲間はあまり重要ではなくなってきています。

曲間を決めたら前後にフェードを書きます。フェードはどんな曲でも必ず書きますね。頭もお尻もフェード・カーブはリニアで、フェード・タイムに関しては、頭は数百ms、お尻は1秒から短いものですと50msくらいとまちまちです。ヴィンテージ・モデリング系のプラグインが普及して以降、波形では無音に見える部分も実はノイズが乗っていたりする。でも設定した曲間部分は完全に無音なわけですから、その部分との整合性を図るためにもフェードを書く必要があります。フェードを書かないとスパッと無音になってしまうので。

曲の頭とお尻を馴染ませるため、必ずフェードを書く

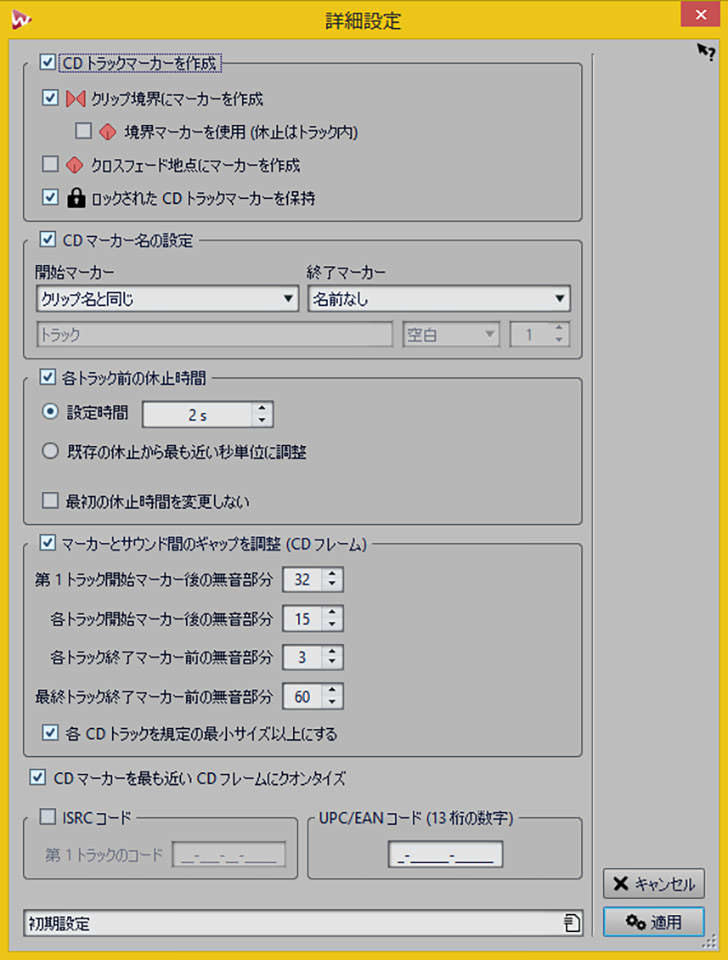

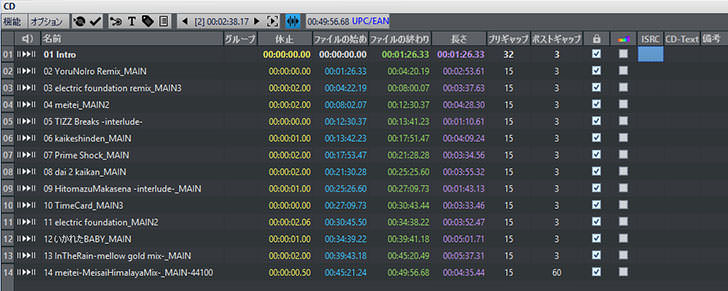

4:マーカーの設定/各種データの入力

次にCDトラックとしてのマーカーを打ちます。曲間を決めてフェードを書いた後に手動でマーカーを打つこともあるんですが、ぼくがよく使うのは、クリップ単位での音作りが終了した段階で、WaveLabの『詳細設定』で自動的にマーカーを打つ方法。『各トラック前の休止時間』は1〜2秒に設定して、『マーカーとサウンド間のギャップを調整』は頭の無音部分(『第1トラック開始マーカー後の無音部分』)は32フレーム、終わりの無音部分(『最終トラック終了マーカー前の無音部分』)は60フレームに設定します(これらはWaveLabの初期設定のままです)。そしてこの自動マーカーを叩き台にして微調整を行う。

『詳細設定』で、マーカーを自動で作成

文字データに関しては、曲名やISRCコード、JANコードを入力します。インディー作品の場合はISRCコード自体が取得されていなかったり、また申請はしたものの取得が間に合わなかったというケースもあります。その場合はプレス業者やレコード会社がISRCコードを記入してくれることもあります。

曲名やISRCコード、JANコードを入力

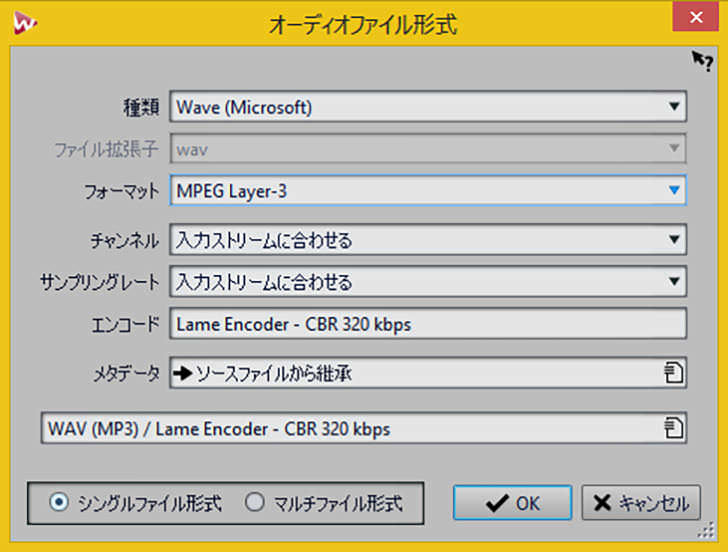

5:書き出し

そして最後に書き出しを行います。マスタリングというと最終的なフォーマットはDDPをイメージする方が多いと思いますが、ぼくの場合はWAVで書き出すことが多いですね。DDPを書き出すのはCDとアナログ・レコードをプレスするときくらい。配信の場合、DDPで書き出す必要はないんです。あとはサンプリング・レートとビット・レゾリューションの問題もありますね。WaveLabの『オーディオモンタージュ』では、DDPに書き出せるのは44.1kHz/16bitだけなんです。しかし48kHzや96kHzが必要な仕事も多いので、それもWAVで書き出す理由の一つです。

最後はファイル・フォーマットを指定して書き出す

ちなみにWaveLab Pro 9から、マスターセクションに『リサンプリング』という項目が加わりました。ここで44.1kHzを指定しておけば、『オーディオモンタージュ』内は48kHz処理でもモニタリングは44.1kHzで行うことができるんです。また、DDPにも直接書き出せるのでとても便利ですね。

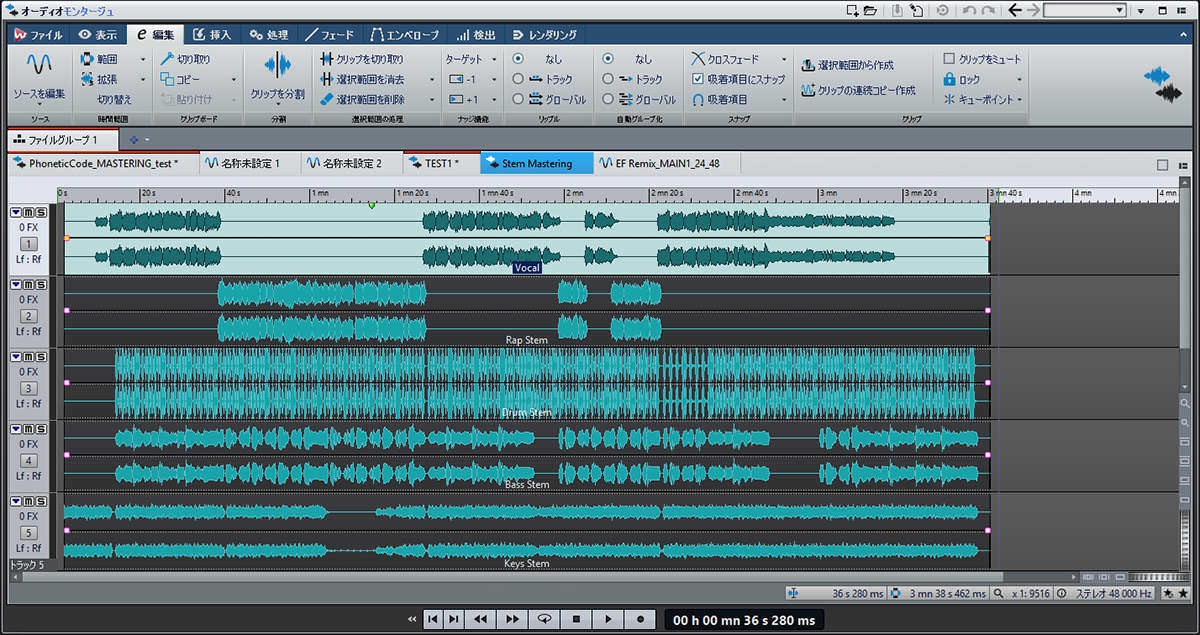

6:ステム・マスタリング

最後に、最近たまに行っている“ステム・マスタリング”についても紹介しておきましょう。“ステム・マスタリング”は、ミックスをいくつかのステムに分けてもらい、それをマスタリング時に合成するという手法です。この手法だとステムごとにプラグインをインサートすることができますし、より細かくサウンドをコントロールすることができます。

複数のステムをマスタリング時に合成する手法、“ステム・マスタリング”

ステムの分け方は、アーティスト・サイドの好みなんですが、大体リード・ボーカル、ラップ、ドラム、ベース、キーボードなどの上物といった感じでしょうか。でも、あんまり細かく分けられてもこっちが大変なだけなので(笑)、ドラムとベースは必ず分けてもらいますが、“あまり細かく分けないでね”とリクエストします。ぼくはイベントや舞台など、特定の環境で再生される音源を手がけることも多いので、そういった仕事のときは“ステム・マスタリング”は特に有効ですね。イベントの音源だったら、アリーナでの鳴りを想定した処理が行えるので。興味のある方はぜひ試してみてください。